2026年1月15日(現地時間)- Black Forest Labsは、同社史上最速となる画像生成モデルファミリー「FLUX.2 [klein]」を発表しました。

FLUX.2 [klein]とは

FLUX.2 [klein]は、画像生成と編集機能を単一のコンパクトなアーキテクチャに統合したモデルです。

最大の特徴は、最先端の画質を維持しながら、エンドツーエンドの推論を1秒未満(サブセカンド)で行える点にあります。品質を犠牲にすることなくリアルタイムな画像生成を必要とするアプリケーション向けに設計されており、13GB程度のVRAMを搭載したコンシューマー向けハードウェアでも動作可能です。

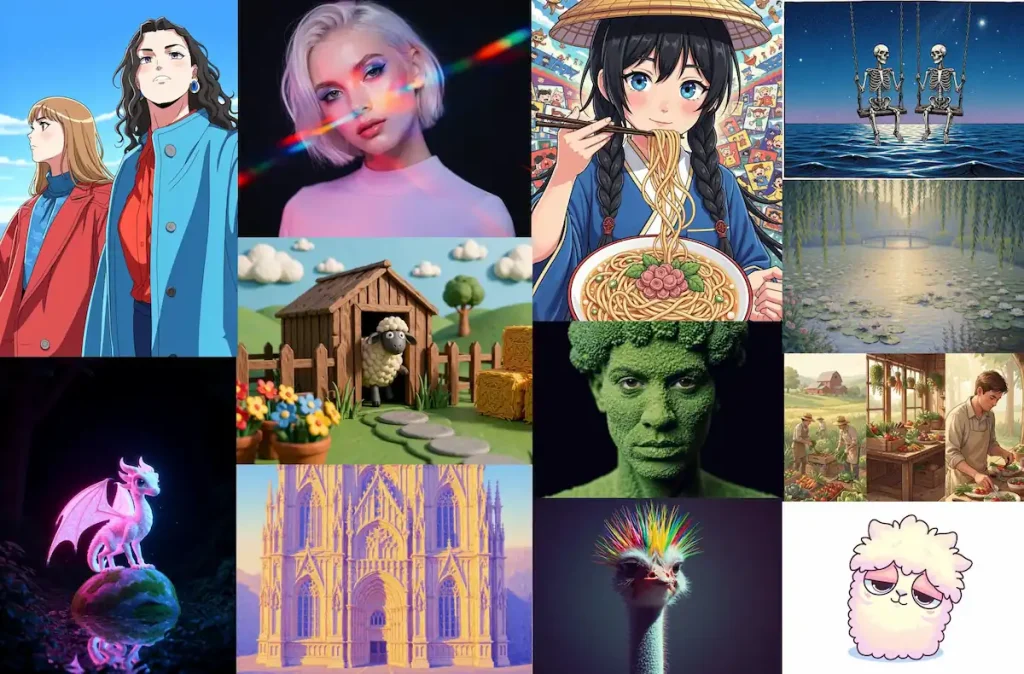

FLUX.2 [klein]による編集プロセスのデモ

「klein(クライン)」はドイツ語で「小さい」を意味し、その名の通り、このモデルのコンパクトさと低レイテンシを象徴しています。

現在は AI エージェントの高度化に合わせて、それに遅れず応答できる視覚生成技術が求められています。リアルタイムで反応し、高速に試行錯誤を繰り返し、さらに一般的なハードウェアでも効率よく動作することが重要です。

FLUX.2 [klein] は小型モデルでありながら機能が制限されておらず、通常はより大規模なモデルでなければ難しい「テキストからの画像生成(Text-to-Image)」「画像編集」「複数リファレンスを用いた生成」といったタスクでも高い性能を発揮します。

主な特徴

FLUX.2 [klein]における主な技術的進歩と特徴は以下の通りです。

- サブセカンド(1秒未満)の推論: 最新のハードウェアにおいて、0.5秒未満での画像生成や編集が可能です。

- フォトリアルで多様な出力: 特にベースモデルにおいて、高い写実性と出力の多様性を実現しています。

- 生成と編集の統合: テキストからの生成、画像の編集、複数リファレンスのサポートを単一のモデルで処理しつつ、フロンティアレベルの性能を維持しています。

- コンシューマーGPUでの動作: 4B(40億パラメータ)モデルは、RTX 3090や4070以上(VRAM約13GB)で動作するように設計されています。

- 開発者フレンドリー: 4BモデルはApache 2.0ライセンス、9Bモデルはオープンウェイトで提供され、カスタマイズやファインチューニングが可能です。

- APIとローカル実行: 本番環境向けのAPI利用だけでなく、フルウェイトを使用したローカル環境での実行もサポートされています。

提供モデルのラインナップ

今回リリースされたFLUX.2 [klein]ファミリーは、用途に合わせて複数のバリエーションが用意されています。

FLUX.2 [klein] 9B

このファミリーのフラッグシップモデルです。90億パラメータのフローモデルと80億パラメータのQwen3テキストエンベッダーをベースに構築され、4ステップの推論に蒸留(distilled)されています。品質と速度のバランスが最適化されており、テキスト生成、単一参照編集、複数参照生成において、5倍のサイズを持つモデルと同等以上の性能を0.5秒未満で発揮します。

ライセンス: FLUX Non-Commercial License (NCL)

FLUX.2 [klein] 4B

最もアクセシビリティの高いモデルであり、Apache 2.0ライセンスの下で完全にオープン化されています。RTX 3090/4070等のコンシューマーGPUに収まるサイズでありながら、T2I(テキストから画像)、I2I(画像から画像)、複数リファレンスに対応。ローカル開発やエッジデバイスへの展開に適しています。

ライセンス: Apache 2.0

FLUX.2 [klein] Base 9B / 4B

蒸留されていない、フル機能の基盤モデルです。完全なトレーニングシグナルを保持しているため、ファインチューニングやLoRAのトレーニング、研究用途など、速度よりも制御性が重視されるカスタムパイプラインの構築に最適です。蒸留モデルよりも出力の多様性に優れています。

ライセンス: 4B BaseはApache 2.0、9B BaseはFLUX NCL

NVIDIA最適化バージョン (FP8 / NVFP4)

NVIDIAとの協力により最適化されたFP8およびNVFP4バージョンもリリースされています。これにより、RTX GPU上での推論がさらに高速化され、メモリ消費も削減されます。

- FP8: 最大1.6倍高速化、VRAM消費を最大40%削減

[9B FP8] / [4B FP8] - NVFP4: 最大2.7倍高速化、VRAM消費を最大55%削減

[9B NVFP4] / [4B NVFP4]

コミュニティ提供の量子化バージョン (GGUF)

公式モデルに加え、UnslothなどのコミュニティによってGGUF形式の量子化モデルも公開されています。

- FLUX.2 [klein] 9B GGUF (Unsloth)

- FLUX.2 [klein] 4B GGUF (Unsloth)

- FLUX.2 [klein] Base 9B GGUF (Unsloth)

- FLUX.2 [klein] Base 4B GGUF (Unsloth)

パフォーマンス分析

FLUX.2 [klein]のEloスコアとレイテンシ(上)、VRAM(下)の比較

ベンチマークによると、FLUX.2 [klein]はQwenモデルと同等以上の品質を、より少ないレイテンシとVRAMで実現しています。

上段のグラフは、Text-to-Image、Image-to-Image(単一リファレンス)、マルチリファレンス生成の各タスクにおける FLUX.2[klein]の Elo とレイテンシを、下段のグラフは VRAM 使用量を示しています。

FLUX.2[klein]は、レイテンシと VRAM を大幅に抑えながら Qwen と同等、あるいはそれ以上の品質を実現し、さらに Z-Image を上回る性能を発揮します。また、テキストからの画像生成とマルチリファレンス対応の画像編集を単一モデルで両立している点も特徴です。

ベースモデル(base variants)は、速度をやや犠牲にする代わりに、カスタマイズ性やファインチューニングの自由度が高く、研究用途や特定のユースケースへの適応に適しています。速度は GB200 上で bf16 により測定されています。

ComfyUIでの利用

FLUX.2 [klein] 4Bおよび9BモデルはComfyUIでサポートされており、ローカル環境にて高速な画像編集や生成を実行可能です。Comfy-Orgより公式のワークフローテンプレートが公開されています。

利用開始手順

- ComfyUIの更新: ComfyUIを最新バージョンにアップデートします。

- ワークフローの準備: 以下のリンクからJSON形式のワークフローをダウンロードし、ComfyUIに読み込みます。用途に合わせたワークフローのJSONファイルがGitHubにて公開されています。またテンプレートも用意されています。

- モデルのダウンロード: ワークフローの指示に従い、HuggingFace等から必要なモデルファイルをダウンロードして所定のディレクトリ(

models/checkpoints等)に配置します。 - 実行: 画像をアップロードし、プロンプトを調整して生成を実行します。

今後の展望

FLUX.2[klein]のリリースは、単に「高速なモデル」を提供するだけではなく、Black Forest Labs が掲げる「インタラクティブな視覚知能(Interactive Visual Intelligence)」へ向けた重要な一歩と位置づけられています。

リアルタイムに“見て・創造し・反復できる”AIは、リアルタイムデザインツールや視覚的推論を行うエージェントといった、新しいタイプのアプリケーションを生み出す基盤になる期待が寄せられています。

関連リソース

FLUX.2 [klein]を試用、または開発に利用するためのリンク集です。

コメント