2024年2月16日(現地時間)- OpenAI はテキストを動画に変換する新しいAIモデル『Sora』を発表しました。

テキストを動画に変換する新しいAIモデル『Sora』

Soraは、テキストの指示からリアルで想像力豊かなシーンを作り出すことができるAIモデルです。

Soraは、ビジュアルクオリティを維持し、ユーザーのプロンプトに忠実でありながら、1分までの動画を生成することができます。また、ユーザーがプロンプトで求めたものだけでなく、それらが物理的な世界にどのように存在するかも理解しており、複数の人物、特定の種類の動き、被写体や背景の正確な詳細を持つ複雑なシーンを生成することが可能となりました。

このモデルは言語を深く理解しているため、プロンプトを正確に解釈し、生き生きとした感情を表現する魅力的なキャラクターを生成することができます。生成された1つのビデオ内で、キャラクターやビジュアル・スタイルを正確に表現する複数のショットを作成することもできます。

OpenAIは、この研究結果を『ビデオ生成モデルのスケーリングが、物理世界の汎用シミュレータを構築するための有望な道であることを示唆している。』としています。

現在のモデルには弱点があることもわかっており、複雑なシーンの物理を正確にシミュレートすることに苦労し、原因と結果の具体的な例を理解できない可能性があります。例えば、人はクッキーをかじっった後、クッキーにはかじった跡がないかもしれない。また、プロンプトの空間的な詳細、たとえば左と右を混同したり、特定のカメラの軌跡をたどるような、時間をかけて起こる出来事の正確な描写に苦戦することもあるとのことです。

Prompt for Video: “Beautiful, snowy Tokyo city is bustling. The camera moves through the bustling city street, following several people enjoying the beautiful snowy weather and shopping at nearby stalls. Gorgeous sakura petals are flying through the wind along with snowflakes.”

■研究手法について

- Soraは拡散(Diffusion)モデルであり、静的なノイズのようなものから動画を生成し、何段階にもわたってノイズを除去しながら徐々に変換していきます。

- Soraは、動画全体を一度に生成することも、生成された動画を延長して長くすることもできます。一度に多くのフレームの先読みをモデルに与えることで、被写体が一時的に視界から外れても、被写体が変わらないようにするという難しい問題を解決しています。

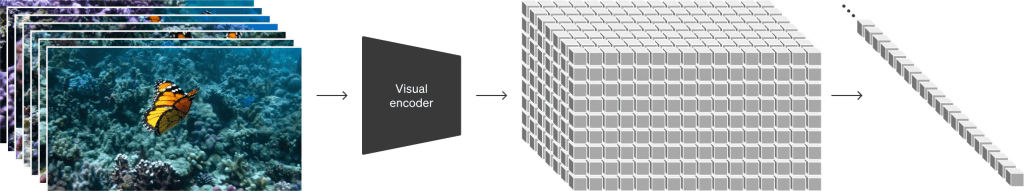

- GPTモデルと同様に、SoraはTransformerアーキテクチャを使用しており、優れたスケーリング性能を発揮します。

- Soraは、動画や画像をパッチと呼ばれる小さなデータ単位の集まりとして表現しており、各パッチはGPTにおけるトークンのようなものです。データの表現方法を統一することで、異なる時間、解像度、アスペクト比にまたがる、従来よりも幅広い視覚データに対してDiffusion Transformerを学習させることができます。

- Soraは、DALL-EとGPTモデルの過去の研究をベースにしています。また、DALL-E 3で採用されたリキャプション技術(ビジュアルトレーニングデータに対して非常に説明的なキャプションを生成する技術)を採用しています。その結果、このモデルは、生成されたビデオ内のユーザのテキスト指示に、より忠実に従うことができます。

より詳しい情報はこちらから

可変時間、解像度、アスペクト比

これまでの画像や動画生成のアプローチでは、標準的なサイズ、例えば256×256の解像度で4秒の動画にリサイズ、クロップ、トリミングするのが一般的でしたが、本来のサイズのデータでトレーニングを行うことで、いくつかの利点が得られることが判明しました。

■サンプリングの柔軟性

Soraは、ワイドスクリーンの1920x1080pの動画、縦長の1080×1920の動画、そしてその中間の動画をサンプリングすることができます。これにより、Soraは異なるデバイス向けのコンテンツをネイティブのアスペクト比で直接作成することができます。また、フル解像度で作成する前に、より小さいサイズで素早くプロトタイプを作成することもできます。

■フレーミングと構図の改善

経験的に、ネイティブアスペクト比の動画でトレーニングすることで、構図とフレーミングが改善されることがわかりました。次の動画は、Soraと、生成モデルをトレーニングする際に一般的に行われる、すべてのトレーニングビデオを正方形にトリミングしたモデルのバージョンを比較です。

■言語理解

テキストから動画生成システムの学習には、対応するテキスト・キャプション付きの大量の動画が必要です。OpenAIは、DALL-Eで導入されたリキャプション技術を動画に適用しました。まず、高度に説明的なキャプションモデルを学習し、次にそれを用いて、学習セット内のすべての動画に対してテキストキャプションを生成します。高度に記述的なビデオキャプションの訓練は、ビデオの全体的な品質だけでなく、テキストの忠実度を向上させることがわかります。

また、DALL-E 3と同様に、GPTを活用して短いユーザープロンプトを長い詳細なキャプションに変換し、ビデオモデルに送信します。これにより、Soraはユーザーのプロンプトに正確に従った高品質のビデオを生成することができます。

画像やビデオによるプロンプト

テキストからビデオへの変換に加えて、Sora は既存の画像やビデオなどを入力として使用することもできます。この機能により、完全にループするビデオの作成、静止画像のアニメーション化、ビデオの前後方向への拡張など、以下のような幅広い画像およびビデオ編集タスクを実行できるようになります。

DALL・E画像をアニメーション化

Sora は、画像とプロンプトを入力として動画を生成することができます。

生成されたビデオの拡張

Soraは、時間軸を前後に延長することも可能です。以下の動画は、生成された動画のセグメントを起点として、時間的に後方に拡張されたものです。それぞれ他のビデオと異なる始まりですが、すべて同じ結末につながります。

この方法を使って、動画を前方にも後方にも延長し、シームレスな無限ループを作り出すことも可能です。

ビデオからビデオへの編集

拡散モデルによって、テキストプロンプトから画像や動画を編集するための多くの方法が可能になりました。Soraは入力映像のスタイルや環境をゼロショットで変換することができます。

動画の連結

Soraは、入力された2つの動画の間を徐々に補間し、被写体やシーンの構成が全く異なる動画間のシームレスなトランジションを作成することもできます。下の例では、中央の動画が左右の動画の間に挿入されています。

画像生成機能

Soraは画像を生成することもできます。これは、ガウスノイズのパッチを1フレームの時間的広がりを持つ空間グリッドに配置することで 行われます。このモデルは、2048×2048の解像度までの様々なサイズの画像を生成することができます。

新しいシミュレーション能力

ビデオモデルは、大規模な訓練を受けると、多くの興味深い能力を発揮することが分かっています。これらの能力により、Soraは物理的な世界の人、動物、環境のいくつかの側面をシミュレートすることができるようになりました。これらの特性は、3Dやオブジェクトなどに対する明示的な帰納的バイアスなしに現れます。

3Dの一貫性:Soraは、ダイナミックなカメラの動きを持つビデオを生成することができます。カメラが移動したり回転したりすると、人物やシーンの要素は3次元空間を一貫して移動します。

長時間コヒーレンスとオブジェクトの永続性:動画生成システムにとって重要な課題は、長い動画をサンプリングする際に時間的一貫性を維持することである。Soraは、短距離依存性(short-range dependencies)と長距離依存性(long-range dependencies)の両方を効果的にモデル化することができます。例えば、Soraは、人や動物や物体がフレームから外れても、その存在を維持することができます。同様に、1つのサンプルで同じキャラクタの複数のショットを生成し、ビデオ全体を通してその外観を維持することも可能です。

世界とのインタラクション:Soraは世界の状態に単純な方法で影響を与える行動をシミュレートできることがあります。例えば、画家がキャンバスに新たなストロークを残し、それが時間と共に持続したり、人がハンバーガーを食べて噛み跡を残したりすることができる。

デジタル世界のシミュレーション:Soraは、Minecraftのプレイヤーを基本的な方針でコントロールすると同時に、世界とそのダイナミクスを忠実にレンダリングすることが可能です。これらの能力は、”Minecraft “に言及したキャプションでSoraをプロンプトすることで、ゼロショットで引き出すことができます。

※シミュレーターとしては多くの制限があります。たとえば、ガラスの粉砕など、多くの基本的な相互作用の物理学を正確にモデル化していません。食べ物を食べるなどの他のインタラクションでは、オブジェクトの状態に常に正しい変化が生じるとは限りません。

利用について

今のところコードなど利用できるものは公開されていないようです。

OpenAIの安全性のセクションでは、SoraをOpenAIの製品で利用できるようにする前に、いくつかの重要な安全対策を講じる予定としています。

コメント